Am Boden der Fertigung beginnt diese Software-Toolchain oft mit dem Manufacturing Execution System (MES). Über OPC UA, MQTT oder proprietäre SPS-Protokolle fließen laufend erfasste Messdaten zu Stromaufnahme, Druckluftverbrauch, Taktzeiten und Ausschuss aus der Maschinensteuerung in Zeitreihen-Datenbanken. Schon einfache Trend- und Musteranalysen decken Leerlaufphasen und Lastspitzen auf, wenn etwa eine Presse in Randzeiten deutlich unter ihrer Kapazität läuft. Moderne MES schlagen automatisiert vor, energieintensive Aufträge in günstigere Tarifzeiträume zu verlegen und steuern etwa Frequenzumrichter oder Pufferspeicher. Dadurch erzielen Betriebe direkt messbare Einsparungen.

ROI nach 18 Monaten

Ergänzend erkennen fortgeschrittene Algorithmen, wenn beispielsweise eine Stanzmaschine in der Nachtschicht regelmäßig nur zu 40 Prozent ausgelastet ist. In solchen Fällen schlägt das System automatisch eine alternative Reihenfolgeplanung vor. Derartige Eingriffe vermeiden Lastspitzen und ermöglichen oft zweistellige Einsparungen beim Energieverbrauch. In einigen Pilotbetrieben lag der ROI solcher Maßnahmen unter 18 Monaten. Diese Echtzeitdaten speisen das Enterprise Resource Planning-System (ERP). Artikel-, Lieferanten- und Buchungsdaten werden um Umweltkennzahlen ergänzt, sodass Stücklisten automatisch Emissionswerte ausweisen. Dashboards verknüpfen diese Daten mit Preisen, Durchlaufzeiten und Deckungsbeiträgen. So erkennen Einkäufer, ob ein günstiger Lieferant zur Emissionsfalle wird. Der Vertrieb kann sichtbar machen, wie sich Materialentscheidungen auf den ökologischen Fußabdruck einer Bestellung auswirken. Nachhaltigkeit wird da-mit zu einem betriebswirtschaftlich steuerbaren Faktor. Auch im Product Lifecycle Management (PLM) zahlt sich Transparenz aus. CAD-Daten, Simulationen und Versuchsergebnisse werden zentral abgelegt. Lifecycle-Assessment-Tools simulieren Varianten, etwa Aluminiumrahmen gegenüber Hybridlösungen aus Stahl und Recyclingkunststoff. So lässt sich der CO2-Fußabdruck bereits vor den ersten Prototypen reduzieren. Erste Auswertungen zeigen bis zu 25 Prozent weniger Ausschuss im Serienanlauf bei gleichzeitig höherer Transparenz gegenüber Kunden und Prüfinstanzen.

Das EMS übernimmt

Damit all diese Daten nicht in isolierten IT-Systemen abliegen, übernimmt das Energiemanagementsystem (EMS) die Koordination. Minutengenaue Zählerdaten, Gebäudeleittechnik und Speichertechnologien speisen ein zeitsynchronisiertes Energiemonitoring, das die Erfassung und Auswertung gemäß ISO 50001 unterstützt. Algorithmen prognostizieren den nächsten Lastgang und können automatisiert Regelketten auslösen, etwa durch Batterieentladung oder Hochfahren von Blockheizkraftwerken. So lassen sich Lastspitzen glätten, was zur zügigen Amortisierung beiträgt. Zusätzliche Logik ermöglicht es, Maschinenstarts zu planen und vertraglich zugesicherte Leistungsgrenzen einzuhalten. Wenn der erwartete Verbrauch einen Peak überschreitet, reagieren Batteriespeicher, Kraft-Wärme-Kopplungsanlagen oder Wärmepumpen automatisch. So lassen sich kurzfristig Kosten vermeiden, die sonst durch hohe Leistungspreise entstehen würden.

Neue Technologie kommt hinzu

Am oberen Ende dieser Architektur sorgt künstliche Intelligenz für einen lernenden Regelkreis. Predictive Maintenance, Anomalieerkennung und Bedarfsprognosen sind vielfach produktiv im Einsatz. Selbstoptimierende Steuerungssysteme werden noch erprobt, doch ihr flächendeckender Einsatz ist absehbar. Ergänzend entstehen auf Planungsebene digitale Zwillinge auf Basis der Verwaltungsschale. Sie simulieren Änderungen vorab, etwa die Umstellung auf den Tagbetrieb, und zeigen deren Auswirkungen auf Emissionen, OEE oder Wartungskosten.

Hohe Hürden bleiben

Trotz dieser Möglichkeiten zögern viele Unternehmen. Ihre Steuerungslandschaften sind historisch gewachsen, basieren auf verschiedenen Protokollen und oft fehlt geeignete Sensorik. Unkalibrierte Messstellen genügen nicht den Reportingpflichten. Dazu kommen volatile Energiepreise, offene CO2-Bepreisung und regulatorische Unsicherheit. Auch mangelt es an digitalen Kompetenzen in IT und Produktion sowie an klarem Change Management. Viele CIOs scheuen proprietäre Systeme wegen späterer Migrationskosten. Die Unsicherheit betrifft aber auch funktionale Fragen: Passen Schnittstellen? Ist das System auditfähig? Lassen sich bestehende Datenquellen sicher einbinden? Immer mehr Unternehmen prüfen deshalb Open Source, standardisierte APIs oder Multi-Cloud-Architekturen.

Den Weg zusammen gehen

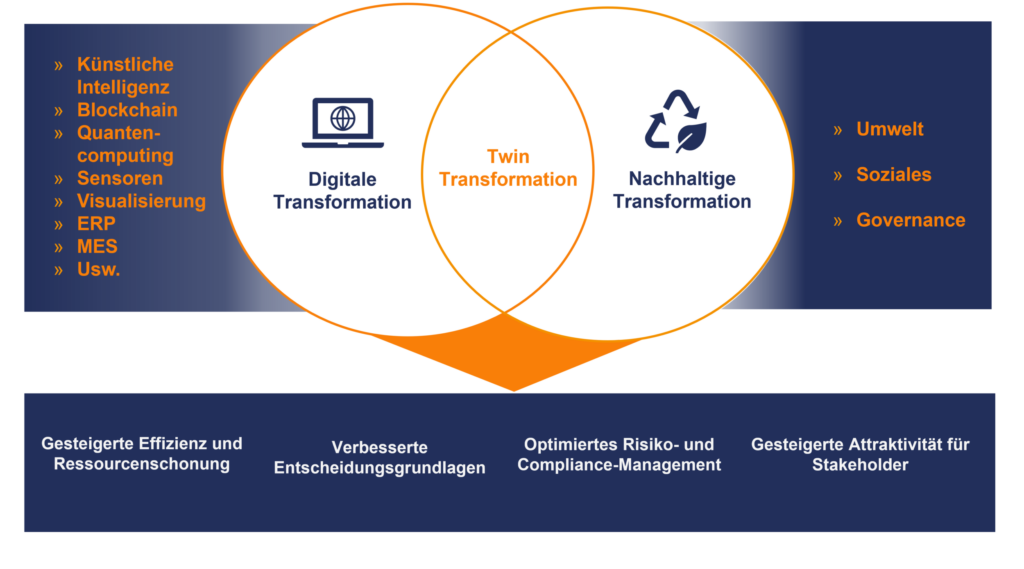

Um den Einstieg in diese Technologien zu unterstützten, bietet der VDMA seinen Mitgliedern einen umfangreichen Use Case-Katalog mit dokumentierten Beispielen für erzielte Einsparungen, eine regelmäßig aktualisierte Anbieterübersicht sowie Lastenheftvorlagen für ISO 50001 und CSRD-Reporting. Beim Infotag ‚Twin Transformation‘ im Juli 2025 trafen Unternehmen des Maschinen- und Anlagenbaus zudem auf Softwareanbieter für Nachhaltigkeitsanwendungen, um Best Practices auszutauschen und Einblicke in Umsetzungswege zu gewinnen. Der VDMA versteht unter dem Begriff Twin Transformation eine Verbindung des digitalen Wandels mit der Umstellung auf eine nachhaltigere Produktion. Das Netzwerk des Verbandes ersetzt keine eigene Strategie, aber es schafft Orientierung in einem Markt, der sich dynamisch entwickelt. Die Quintessenz lautet daher: Nachhaltigkeit ohne Daten bleibt Absicht. Daten ohne Software bleiben ungenutzt. Erst wenn alle Softwareschichten der Automatisierungspyramide zu einer möglichst integrierten Architektur verschmelzen, lassen sich beide Ziele erreichen. Wer diesen Weg einschlägt, erfüllt nicht nur Berichtspflichten leichter, sondern kann Effizienz, Resilienz und Wettbewerbsfähigkeit erhöhen.