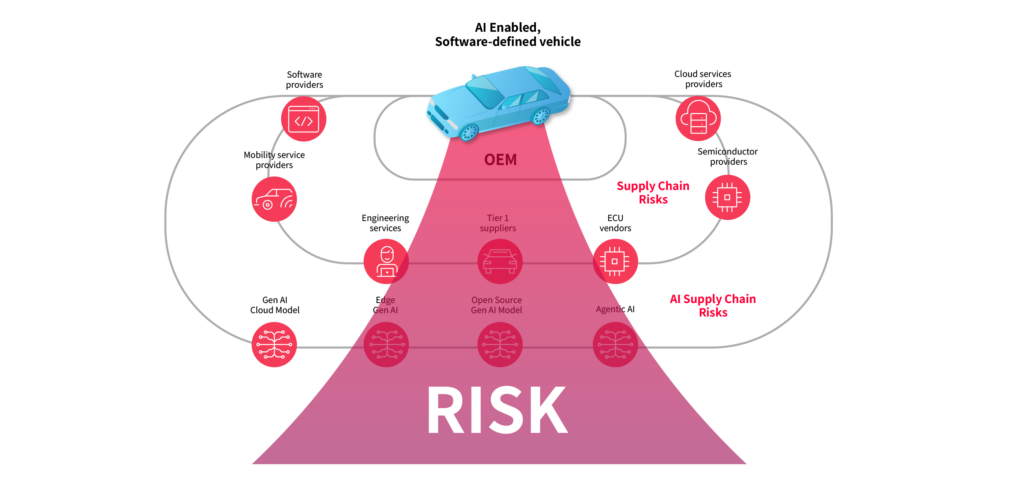

Die Integration von GenAI in Fahrzeugsysteme bringt neben neuen Funktionen auch die Einbettung von IT-Komponenten mit sich, die über den gesamten Lebenszyklus eigenständig lernen, sich weiterentwickeln und autonom arbeiten. Nach Einschätzung des Automotive-Cybersecurity-Anbieters VicOne entsteht dadurch eine neue Bedrohung für die Automobilindustrie. Viele Hersteller (OEMs) sind für Training und Bereitstellung dieser Modelle auf Drittanbieter angewiesen und haben keinen Einblick in die Trainingsdaten oder die Verfahren. GenAI-Modelle unterscheiden sich damit deutlich von klassischen Softwarekomponenten und stellen ein zusätzliches Risiko in den Lieferketten dar.

Unsicherheiten bei Training und Bereitstellung

Das Verhalten von GenAI-Modellen hängt von den Daten ab, mit denen sie trainiert wurden und von den Mechanismen des kontinuierlichen Lernens. Dadurch lassen sie sich mit etablierten Testmethoden meist nicht vollständig absichern. Da häufig externe Partner Modelltraining und Optimierung übernehmen, verteilen sich die Risiken über alle Phasen des Lebenszyklus. Hinzu kommt, dass sich die Herkunft der Trainingsdaten oft nicht überprüfen lässt und auch nicht ersichtlich ist, ob sensible Informationen bei der Feinabstimmung offengelegt wurden. Zudem können Modelle ihr Verhalten mit der Zeit verändern.

Schwachstellen der Modelle

VicOne verweist auf Schwachstellen, die gerade bei häufig verwendeten Open-Source-Modellen auftreten. Laut dem Enkrypt AI Safety Leaderboard überschreiten die zehn am meisten heruntergeladenen Open-Source-Modelle die vom US?National Institute of Standards and Technology gesetzte Sicherheitsschwelle. Es wurden bereits reale Angriffe bekannt. Auch Google musste jüngst Sicherheitslücken in seiner Plattform Vertex AI schließen, über die Angreifern Manipulationen der trainierten Modelle möglich gewesen wären.

Gefahren durch verfälschte Trainingsdaten

Ein zweiter Bereich betrifft die Risiken verfälschter Daten. Bei der Feinjustierung von KI-Modellen kommen teilweise sensible Daten wie Kundendienstdaten, Wartungsprotokolle oder Fahrtenbücher zum Einsatz. Öffentlich verfügbare Datensätze erhöhen die Gefahr zusätzlich. So entdeckten Sicherheitsforscher im Jahr 2024 auf der Plattform Hugging Face 100 bösartige Modelle zur Codeausführung. Werden kompromittierte Daten bei der Anpassung von Modellen integriert, gelangen Schwachstellen dauerhaft ins System und können spätere Angriffe erleichtern. Schon eine relativ kleine Zahl manipulierter Beispiele innerhalb größerer Datensammlungen kann das Verhalten von GenAI-Modellen verlässlich verändern.