Initiativen wie die IDTA (Industrial Digital Twin Association) und die Open Industry 4.0 Alliance wollen Standardisierung voranbringen, doch der flächendeckende Durchbruch steht noch aus. Die Verwaltungsschale (AAS) gilt als digitaler Zwilling industrieller Assets und ermöglicht deren standardisierte Beschreibung und Vernetzung. Ihre Umsetzung befindet sich in der Prozessindustrie noch in der Pilotphase, insbesondere mangelt es an durchgängigen Werkzeugen und breit akzeptierten Submodellen. KI gewinnt an Bedeutung, etwa für vorausschauende Wartung oder Qualitätskontrolle. Neben neuronalen Netzen und Machine Learning (ML) werden zunehmend Large Language Models (LLMs) wie GPT oder Claude in der Prozessautomatisierung eingesetzt. Der Status Quo ist geprägt von Pilotprojekten und explorativen Anwendungsfällen, insbesondere in der Mensch-Maschine-Kommunikation, dem automatisierten Dokumentenverständnis, bei Anomalieerkennung und der Assistenz in Wartungs- oder Supportprozessen.

Glanz und Grenzen von LLM

In der Fertigungsindustrie und Prozessautomatisierung sind LLMs besonders interessant für die semantische Auswertung unstrukturierter Daten, etwa aus Schichtberichten, Wartungsprotokollen oder Fehlertexten. Ebenso dienen sie als Bindeglied zwischen natürlichen Spracheingaben und maschinennahen Steuerungslogiken, etwa in Low-Code/No-Code-Interfaces. Dennoch bestehen Grenzen: LLMs sind nicht deterministisch, was sie für sicherheitskritische Steuerungsaufgaben bislang ungeeignet macht. Zudem fehlt es häufig an branchenspezifisch feinjustierten Modellen und hochwertigen, domänenspezifischen Trainingsdaten. Datenschutz, Vertraulichkeit und regulatorische Anforderungen stellen weitere Herausforderungen dar, insbesondere bei Cloud-basierten Modellen.

Potenzial ist offenbar

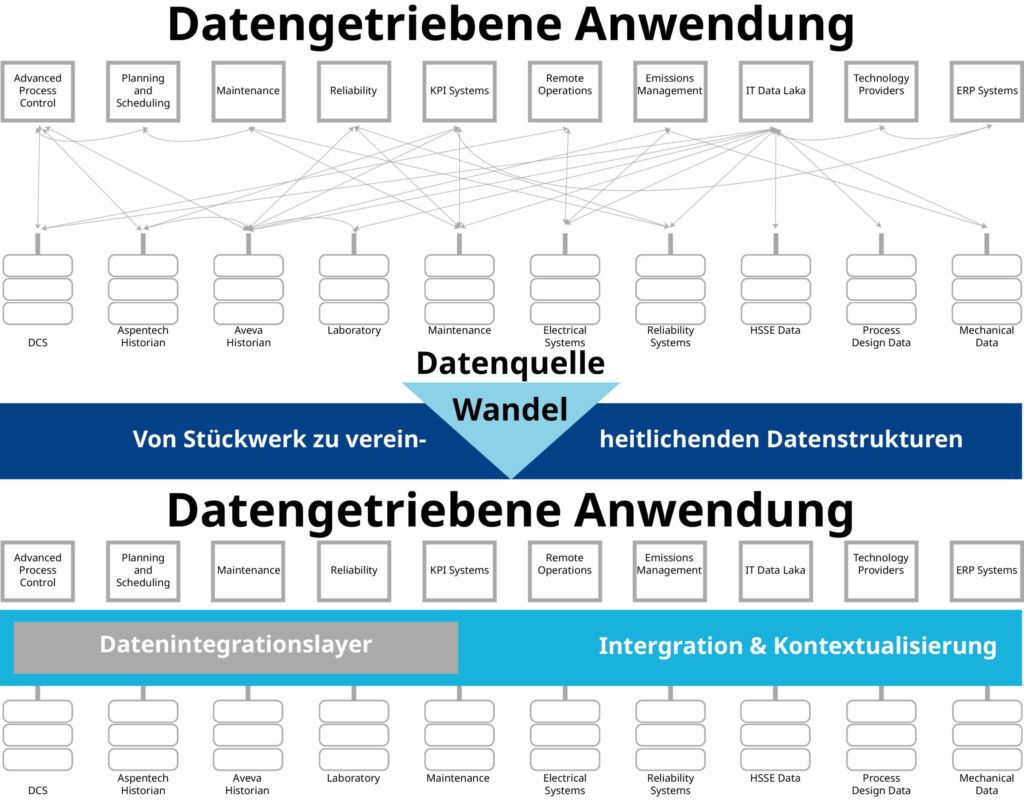

Der Weg zur intelligenten, vernetzten Automatisierung ist vielversprechend, aber komplex. Fortschritte hängen nicht nur von Technologie ab, sondern auch von Standardisierung, Systemoffenheit und interdisziplinärer Zusammenarbeit über Unternehmens- und Branchengrenzen hinweg. Die Basis und die treibende Kraft dieser technischen Neuerungen und Entwicklungen sind Daten. Trotz großer Erwartungen scheitern die meisten Big Data-Projekte – Schätzungen zufolge bis zu 85 Prozent – an grundlegenden Herausforderungen. Ein zentraler Grund ist der Mangel an Datenqualität und -konsistenz. Fehlende Standards, fragmentierte Systeme und Silostrukturen führen dazu, dass Daten weder vertrauenswürdig noch nutzbar sind. Ein einheitlicher Ansatz zum Datenman-agement von IT- und OT-Daten wirkt dem entgegen, wenn sie den regulatorischen Anforderungen entspricht und zugleich für die vielen veränderlichen Applikationen und Anwendungsfälle offen bleibt. Drei Aspekte sind besonders zu berücksichtigen:

Technik und Schnittstellen

Ein zukunftsfähiges Datenmanagementsystem zeichnet sich technisch durch eine offene, modulare Architektur mit standardisierten Schnittstellen (OPC UA, MQTT, REST). Es ist skalierbar für wachsende Datenmengen, unterstützt Cloud- und Edge-Integration, Datenintegrität gemäß Alcoa+, sowie Echtzeitdatenverarbeitung. Sicherheitsfunktionen wie Verschlüsselung, rollenbasierte Zugriffe und Audit-Trails sollten ebenfalls integriert sein. Microservices und Containerisierung helfen beim Erweitern und der Systempflege. Der ETL-Prozess (Extraktion, Transformation, Laden) soll durch eine Reihe von Funktionen effektiv realisiert werden, wobei der Kontext (Ontologie) der Daten oft entscheidend für den Nutzwert der Daten ist. Unterstützung für KI- und Analyseplattformen ist ebenfalls zunehmend gefragt.

Der laufende Betrieb

Betrieblich sollten Datenmanagementsysteme vor allem nicht ausfallen, einfach administrierbar, integrierbar sowie benutzerfreundlich sein. Wichtige Funktionen sind oft rollenbasierte Zugriffe für Nutzergruppen wie Produktion und Qualitätssicherung. Automatisierte Backups, Selbstüberwachung und standardisierte Validierungsunterstützung erleichtern den Betrieb im regulierten Umfeld. Dashboards, Berichte und Alarme unterstützen Mitarbeitende bei Entscheidungen.

Bezahlbar und transparent

Finanziell sollte sich das System durch transparente Lizenzmodelle auszeichnen. Eine gute Integrierbarkeit senkt den Migrationsaufwand. Erweiterbarkeit, Cloud-Fähigkeit und regulatorische Konformität erhöhen die Zukunftsfähigkeit. Datenbasierte Optimierungsmöglichkeiten etwa zur Effizienzsteigerung, Qualitätsverbesserung oder Predictive Maintenance tragen zur Wirtschaftlichkeit bei.

Extract, Transform, Load effektiv und standardisiert

Dem ETL-Prozess kommt dabei eine kritische Rolle zu. Er bereitet Daten aus verschiedenen Quellen auf, sichert Datenqualität, Konsistenz und Integration. Die Aufgabe ist komplex, da unterschiedliche Formate, inkonsistente Daten und hohe Datenvolumen berücksichtigt werden müssen. Zudem erfordert ETL technisches Knowhow, präzise Planung und laufende Wartung, um zuverlässige, nutzbare Informationen zu liefern. Der ETL-Prozess wird traditionell von jeder Applikation separat behandelt, was zu einer Vielzahl unterschiedlicher Methoden und Vorgehen führt – Fall für Fall. Oft effizienter wäre es, wenn das Datenmanagement-Werkzeug den ETL-Prozess für alle Anwendungen gleichbleibend effektiv ausrichtet.

Plattform von Emerson

Die Datenmanagementplattform AspenTech Inmation von Emerson ist darauf ausgelegt, Industriedaten aus verschiedenen Quellen innerhalb eines Unternehmens zu verbinden, zu kontextualisieren und zu transformieren. Sie soll eine sichere, herstellerunabhängige Integration mit Betriebs- und IT-Systemen bieten und so einen Zugriff auf Echtzeit- und historische Daten ermöglichen. Die Plattform unterstützt zentralisierte Verwaltung, Cloud- oder Hybrid-Architekturen und eine Vielzahl von Datentypen.

Neben dem eingesetzten Produkt ist auch der Prozess von zentraler Bedeutung, der das System umgibt. So können durch die Kontextualisierung von Daten eigene Wertschöpfungssysteme entstehen. Daten sinnvoll zu integrieren und durch schrittweises Hinzufügen von Kontexten wertvoller zu machen wird zu einem Erfolgsfaktor, da die Automatisierung von Produktions- und Geschäftsprozessen davon stark abhängen. Entscheidend ist dabei eine tragfähige Datenstrategie, die technologische Leistungsfähigkeit, betriebliche Effizienz und wirtschaftliche Skalierbarkeit vereint – und so die Grundlage schafft für ein flexibles und zukunftssicheres Datenökosystem in der industriellen Automatisierung.