In den letzten Jahren wurden zwar innovative, optische und akustische Bedienkonzepte zur Bedienung von Geräten und Maschinen entwickelt, die sich aber aus Kostengründen nur in Einzelfällen durchsetzen konnten. Dabei ermöglichen Embedded-Computing-Module heute eine oft kostengünstige Umsetzung dieser Konzepte, die mittlerweile auf künstliche Intelligenz (KI) und mehr Konnektivität setzen. War die Bildverarbeitung bislang auf die Beobachtung von Prozessen zur Steuerung und Reglung in der Automation fokussiert, kommen jetzt zunehmend auch HMI-Aufgaben hinzu, gerade weil so eine kontaktlose Bedienung möglich wird. So könnte die Integration einer Kamera in das HMI künftig etwa Zusatzgeräte wie Barcodescanner ersetzen. An Maschinen und Anlagen könnten integrierte Kameras eine biometrische Authentifizierung per Gesichtserkennung realisieren, auch zur Zwei-Token-Authentifizierung für Anwendungen mit einem erhöhten Sicherheitsbedarf. Auch hier ist KI gefragt, allerdings gekoppelt mit zusätzlichen Security-Funktionen, die möglichst tief in der Hardware integriert sind.

Auf’s Wort hören

KI kommt auch in der Sprach- oder Geräuscherkennung zum Einsatz. Die akustische Bedienung hilft wieder, wenn alle Hände im Einsatz sind und zusätzlich die Augen nicht abgewendet werden können, etwa bei Medizintechnik-Produkten für Chirurgen. In einigen Situationen, speziell bei Verkaufsautomaten und Bezahlstationen, ist eine Audioverarbeitung nützlich, die mehrere Mikrofone auswerten kann, um Störgeräusche besser zu filtern.

Sensoren erweitern Optionen

Manchmal braucht es kein revolutionäres neues Bedienkonzept, sondern die clevere Optimierung eines bestehenden HMIs. So können beispielsweise Beschleunigungssensoren aus der Lageposition erkennen, in welchem Zustand das Gerät ist und welche Bedienschritte sinnvoll sind. Oder es lässt sich mit Lidar-Sensoren die automatische Positioniergenauigkeit erhöhen und mögliche Stellzeiten durch den Menschen reduzieren – hier punktet ein HMI also nicht durch eine intuitivere, sondern durch eine schnellere Bedienung. Allerdings muss die Hardware die entsprechenden Sensor-Schnittstellen unterstützen. SAP-Verantwortliche wissen, dass sie handeln müssen – aber nicht, wie sie fundiert entscheiden. ‣ weiterlesen

SAP-Transformation mit Augenmaß: Sicherheit für die richtige Entscheidung

Embedded-Module von TQ

Die Multitouch-Bedienung der Smartphones als Vorlage für HMIs ist also längst nicht das Ende der Entwicklung zur intuitiven, zuverlässigen und sicheren Gerätebedienung. Die aktuellen Halbleiterdesigns greifen die Trends auf und integrieren die notwendige Funktionalität in die CPUs. Ein Beispiel ist der i.MX 95 von NXP, der neben den Arm-Cores über einen KI-Beschleuniger mit einer Spitzenleistung von 2 TOPS verfügt. Dieser Baustein ist die Grundlage für die TQ-Embedded-Module TQMa95xxSA und TQMa95xxLA. Um sich dem Leistungsbedarf der Anwendung und ihrem HMI anpassen zu können, stehen die Module mit zwei, vier oder sechs Arm Cortex-A55-Cores zur Verfügung. Zwei unabhängige Echtzeit-Domänen (Arm Cortex-M7 und Arm Cortex-M33) stehen etwa für Sicherheits-/Low-Power- und Hochleistungs- Echtzeitanwendungen zusätzlich zur Verfügung. Mit bis zu 16 GB LPDDR5, bis zu 256 Megabyte Quad-SPI NOR-Flash und bis zu 256 Gigabyte eMMC bieten die Module auch für sehr umfangreiche HMIs genügend Speicherplatz. Mit JUNOfy finden Mitarbeitende genau die Informationen, die sie wirklich brauchen – schnell, zuverlässig und ohne langes Suchen in verschiedenen Systemen. Statt Datenchaos: klare Antworten. Für effizientere Prozesse, weniger Stress und einen reibungslosen Arbeitsalltag.

Mit JUNOfy finden Mitarbeitende genau die Informationen, die sie wirklich brauchen –

Für Bildanalysen geeignet

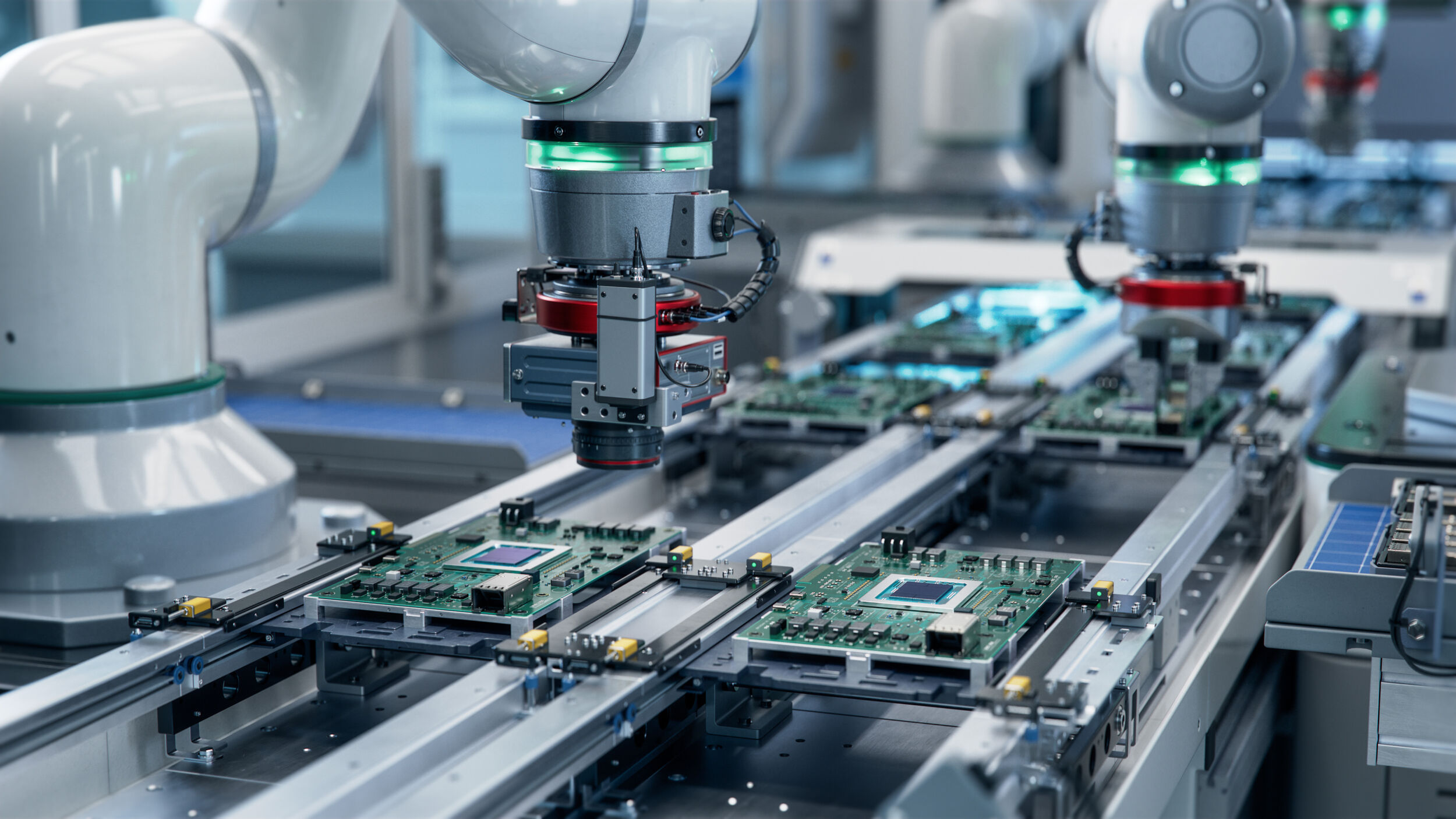

Die Modul-Familie ermöglicht Bildanalysen durch den integrierten KI-Beschleuniger NXP eIQ Neutron als Teil einer Machine-Vision-Pipeline für den Einsatz mit netzwerkfähigen Smart-Kameras oder mehreren Kamerasensoren. Letztere unterstützt der NXP ISP (Image Signal Processor) und ermöglicht so die Nutzung einer breiten Palette von Bildsensoren für Industrie-, Robotik-, Medizin- und Automobilanwendungen. Diese Bildverarbeitungspipeline ermöglicht vielfältige Bildverarbeitung wie Gesten- oder Personenerkennung. Allerdings ist Bildanalyse für viele Entwickler Neuland, deshalb gewinnt der Software-Support an Bedeutung. NXPs eIQ Neutron NPU und die Entwicklung von Anwendungen für Maschinelles Lernen (ML) werden durch das preisgekrönte eIQ ML Software Development Environment unterstützt, eine Sammlung von Bibliotheken und Entwicklungswerkzeugen für die Erstellung von ML-Anwendungen für ML, die für i.MX-Anwendungsprozessoren und MCUs entwickelt wurden. Das eIQ-Toolkit nutzt Open-Source-Technologien und ist in die Yocto-Entwicklungsumgebungen integriert, was die Entwicklung kompletter Anwendungen auf Systemebene erleichtern soll.

Grafik in 4k möglich

Für die Grafikdarstellung mit Auflösungen bis zu 3840 x 1440p60 sorgt die integrierte Arm Mali-GPU sowie 2 x LVDS auf vier Lanes und 1 x eDP auf zwei Lanes. Das Modul ist zudem für die Audioverarbeitung und -signalisierung ausgestattet und kann optional einen Gyroscope-Sensor der TQMa95xxSA/LA-Familie mitbringen. Für die Kommunikation mit Netzwerken bzw. Netzwerk-Kameras stehen bis zu zwei x GBit-Ethernet- (TSN-fähig) und eine x 10GBit-Ethernet-Schnittstellen zur Verfügung.