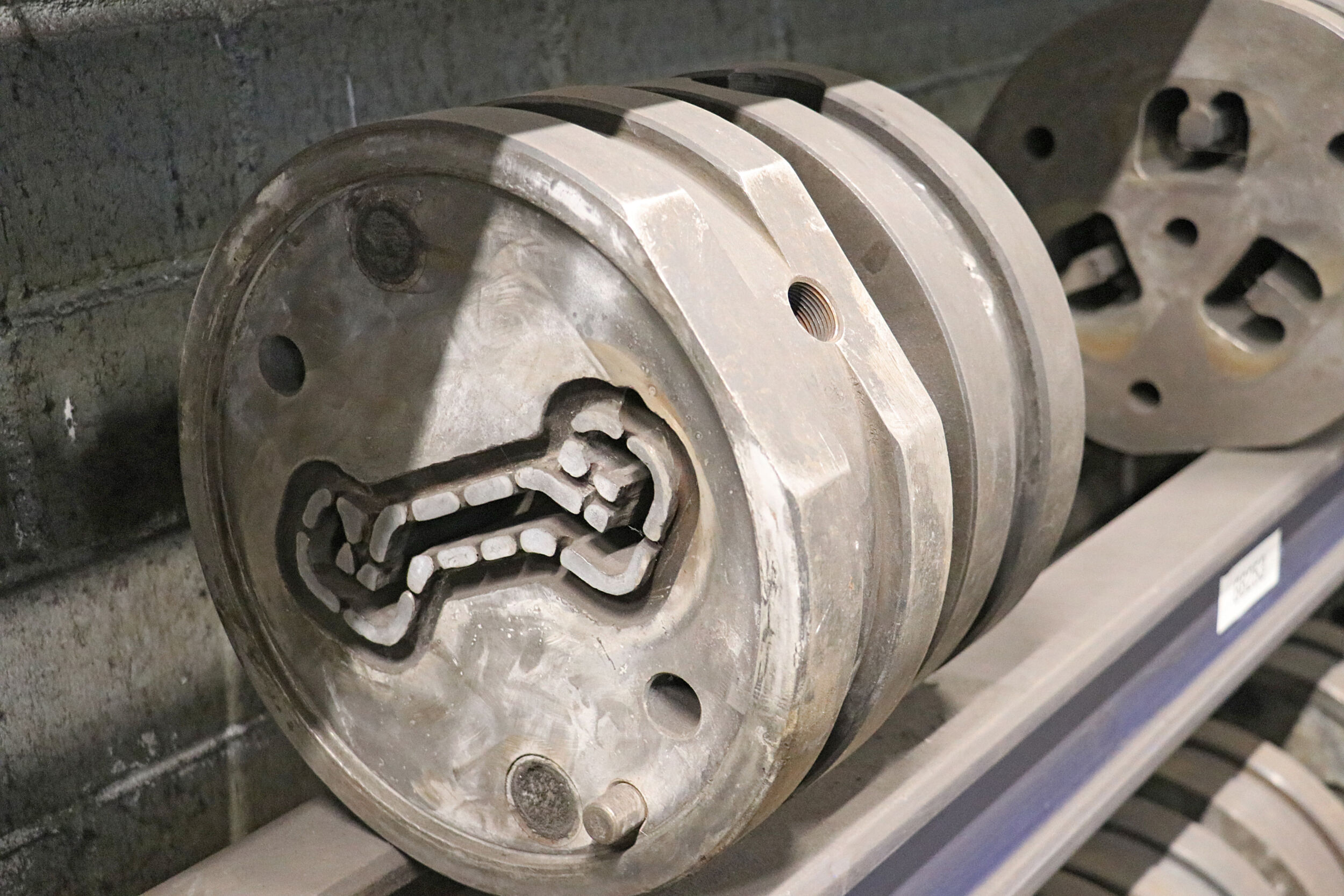

Bauteile werden schneller gefertigt, Qualitäts- und Effizienzanforderungen steigen kontinuierlich, während gleichzeitig die Varianz von Produkten und Prozessen zunimmt. Klassische, regelbasierte Bildverarbeitungssysteme stoßen dabei zunehmend an ihre Grenzen – insbesondere dann, wenn kleinste Oberflächenfehler und komplexe Geometrien bei stark schwankenden Prozessbedingungen zuverlässig erkannt werden sollen.

In der Linie geprüft

Ein wesentliches Merkmal moderner Inspektionssysteme ist ihre tiefe Integration in den Produktionsablauf. Zudem erfolgt die visuelle Prüfung häufig nicht mehr nur stichprobenartig am Ende der Linie, sondern kontinuierlich während der Fertigung. Daraus ergeben sich strenge Anforderungen an Latenz und Taktzeit. Entscheidungen müssen innerhalb enger Zeitfenster getroffen werden, ohne den Materialfluss zu beeinträchtigen. „Gerade bei Oberflächeninspektionen müssen oft sehr große Bilder verarbeitet werden, oder es sind sogar mehrere Kameras aus unterschiedlichen Perspektiven im Einsatz“, sagt Behar Veliqi, Co-Founder & CTO von Maddox AI. Das Unternehmen entwickelt KI-Software für die visuelle Qualitätsprüfung in der industriellen Fertigung. „Je höher die Auflösung und je komplexer der Anwendungsfall, desto wichtiger wird eine performante Ausführung der KI direkt vor Ort.“ Hinzu kommt, dass viele Produktionsanlagen bereits über bestehende Kameras und Beleuchtungssysteme verfügen, die in neue KI-Systeme integriert werden müssen.

GPU-basierte Edge-Nodes

Das Herzstück moderner Embedded-Inspektionssysteme bilden meist GPU-basierte Edge-Nodes. Diese Systeme kombinieren kompakte Bauformen mit hoher Rechenleistung und sind speziell für die Ausführung neuronaler Netze optimiert. Im Vergleich zu CPU-basierten Ansätzen ermöglichen sie eine um ein Vielfaches schnellere Inferenz. Mit seiner gleichnamigen KI-Software für industrielle Bildverarbeitung adressiert etwa Maddox AI diese Herausforderungen. Das Produkt verbindet GPU-basiertes Edge-Deployment mit einer Cloud-Plattform und ermöglicht so skalierbare sowie robuste Inspektionssysteme für einfache bis komplexe Produktionsumgebungen. Viele Anwendungsfälle sind ohne GPUs schlicht nicht realisierbar, sagt Veliqi. „Insbesondere wenn mehrere Kamerastreams parallel verarbeitet oder sehr große Bilddaten analysiert werden müssen, überfordert dies CPUs.“

Standardisierte Architektur

Der Anbieter verzichtet auf klassische Smart Cameras. Statt Rechenleistung in Kameras zu integrieren, übernimmt das der zentrale Industrie-PC, an den die Kameratypen angebunden werden. Unterstützt werden u.a. GenICam-kompatible Industriekameras, Zeilenkameras sowie spezialisierte Bildquellen. „Smart Cameras sind für einfache Anwendungen durchaus sinnvoll, haben aber wiederum bei komplexen Use Cases ihre Schwächen“, sagt Veliqi. „Hohe Auflösungen, viele Fehlerklassen oder spezielle Bildformate lassen sich mit einem zentralen IPC deutlich flexibler und wirtschaftlicher abbilden.“

Stabilität und Reproduzierbarkeit

Um die Applikation stabil aufzustellen, kombiniert Maddox AI mehrere Ansätze. Die KI-Modelle werden zentral in der Cloud trainiert und vor dem Einsatz in der Produktion anhand realer Daten simuliert. „So lässt sich bereits vor dem Rollout abschätzen, wie sich ein neues Modell auf Ausschussraten und Prozessstabilität auswirkt“, schildert Veliqi. Für die Inferenz auf dem Edge werden die Modelle zusätzlich optimiert, etwa durch den Einsatz von Nvidia TensorRT. Darüber hinaus setzt das System auf modulare Modellarchitekturen, bei denen mehrere Fehlerklassen gemeinsam verarbeitet werden. Die Sicherstellung konsistenter Trainingsdaten und ein zweistufiger Ansatz aus überwachten Modellen und ergänzender Anomalieerkennung tragen dazu bei, auch unter wechselnden Bedingungen robuste Ergebnisse zu liefern.

Cloud und Edge

Während die Inspektion mit Maddox AI am Edge erfolgt, übernimmt die Cloud eine zentrale Rolle bei Training, Simulation und Verwaltung der Modelle. Mehrere Modellvarianten können parallel entwickelt, getestet und versioniert werden, ohne den laufenden Produktionsbetrieb zu unterbrechen. „Die Trennung von Training und Inferenz ist ganz essenziell“, so Veliqi. „Sie erlaubt es, neue Modelle iterativ zu verbessern und erst dann in die Linie zu bringen, wenn sie die gewünschten Ergebnisse liefern.“ Updates werden kontrolliert per Knopfdruck ausgerollt und können bei Bedarf automatisch auf eine vorherige Version zurückgesetzt werden.

Fazit

KI-basierte Inline-Inspektion stellt hohe Anforderungen an Latenz, Rechenleistung und Systemstabilität. Reine Cloud-Ansätze sind dafür in der industriellen Praxis meist ungeeignet. Edge-Deployment auf GPU-basierten Embedded-Systemen verspricht die erforderliche Echtzeitfähigkeit, Wirtschaftlichkeit und Robustheit, die Industrielle Anwendungen oft erfordern. In Kombination mit cloudgestütztem Training und zentralem Modellmanagement entsteht ein Ansatz, der den wachsenden Qualitätsanforderungen moderner Produktionslinien Rechnung tragen soll – insbesondere dort, wo klassische Bildverarbeitung und reine Cloud-Konzepte nicht mehr ausreichen.