Große KI-Modelle wie GPT-4.5 oder OpenAI o3 bilden die Speerspitze des technologischen Fortschritts. Deren Entwicklung verschlingt jedoch viel Manpower und verursacht gigantische Kosten. Die Modelle selbst belegen darüber hinaus riesige Speicherkontingente und verbrauchen enorme Rechenleistungen – und damit Energieressourcen. Einige dieser Probleme adressiert AI Distillation (auch Wissensdestillation genannt). Doch was steckt hinter diesem Begriff? HTEC, ein Entwickler kundenspezifischer Hardware- und Software, klärt auf.

Was ist AI Distillation?

HTEC beschreibt AI Distillation als ein Verfahren, bei dem das Wissen großer KI-Modelle (Lehrermodelle) auf kleinere, effizientere Modelle (Schülermodelle) übertragen wird. Ziel ist es, die Leistung der großen Modelle zu bewahren und gleichzeitig Rechenaufwand, Energieverbrauch und Kosten deutlich zu reduzieren. Dazu werden sogenannte weiche Vorhersagen übernommen, die nicht nur die endgültigen Entscheidungen, sondern auch die Wahrscheinlichkeiten und Unsicherheiten des Lehrermodells widerspiegeln – die kleineren Modelle lernen also nicht nur die richtigen Antworten, sondern auch, wie sicher sich das große Modell dabei ist.

Wo kommt AI Distillation zum Einsatz?

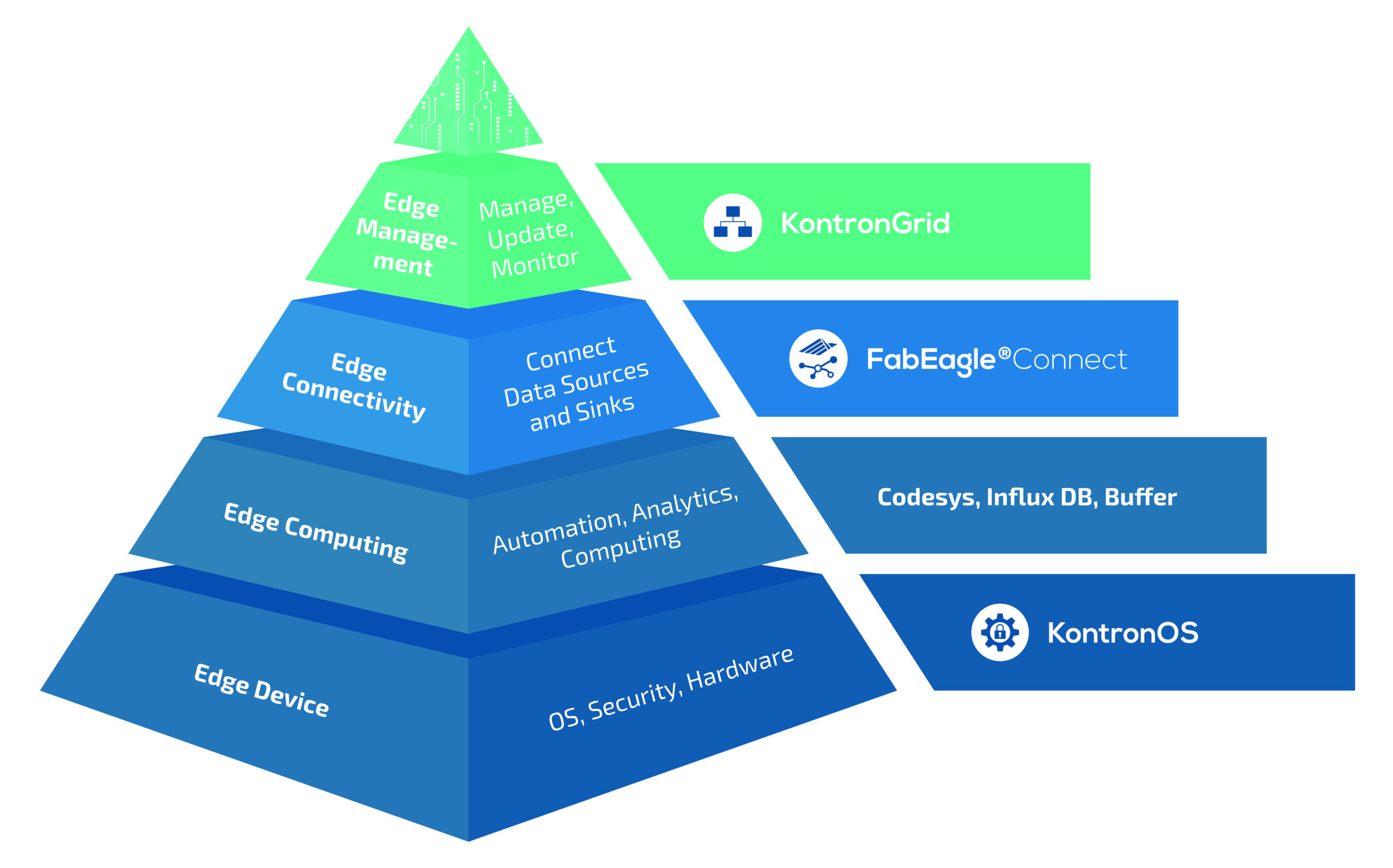

Für Anwendungen in Echtzeit, auf mobilen Geräten oder in ressourcenbegrenzten Umgebungen sind große KI-Modelle wie GPT-4 oder BERT oft ungeeignet. AI Distillation ermöglicht es, KI-Modelle in Bereichen wie Edge Computing oder IoT-Anwendungen einzusetzen, die bisher wegen begrenzter Ressourcen keinen Use Case darstellen konnten.

Wie funktioniert AI Distillation?

HTEC beschreibt Prozess der Wissensdestillation in drei Schritten: Zuerst zeigt das große Lehrermodell, wie wahrscheinlich bestimmte Antworten bei den Trainingsdaten sind – entweder mit einem Live-Training oder aus vorher gespeicherten Ergebnissen. Danach wird das kleinere Schülermodell so trainiert, dass es diese Antworten möglichst genau nachahmt. Dabei helfen spezielle Methoden, die in der Pressemitteilung nicht näher beschrieben werden, um Unterschiede in den Vorhersagen möglichst klein zu halten. Am Ende wird das Schülermodell mit neuen Testdaten geprüft und verbessert, damit es ähnlich gut wie das große Modell funktioniert – aber sehr viel effizienter.