Jedes verkaufte Teil, jede Maschine und technische Komponente sowie die damit verbundenen IT-Systeme sind zu eigenen, individuellen Datenquellen geworden, die täglich und über den gesamten Produktlebenszyklus hinweg Informationen liefert. Darin schlummert Potenzial für die Produktentwicklung und -optimierung sowie für die Bereitstellung datenbasierter Services und die Umsetzung neuer gesetzlicher Anforderungen.

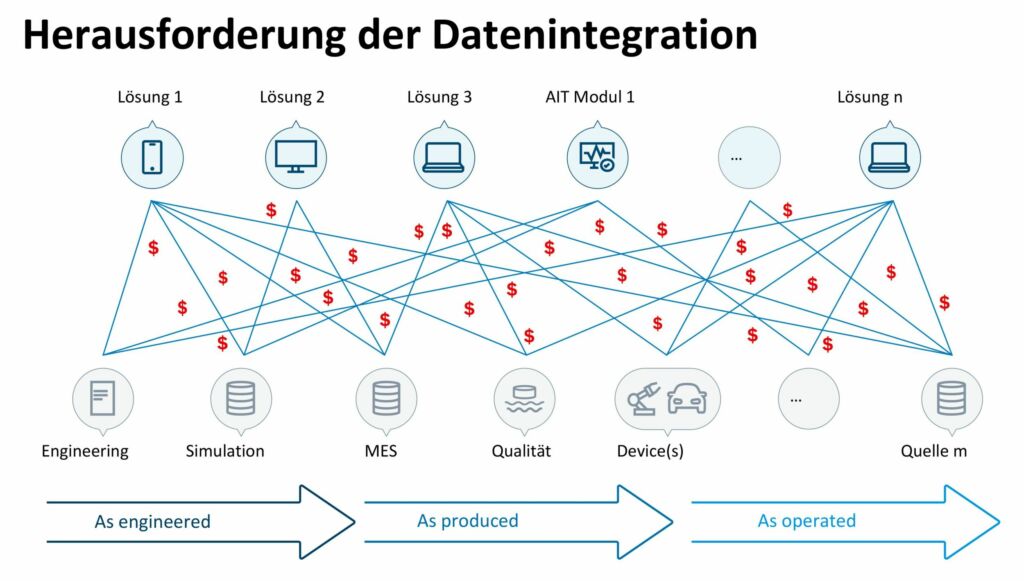

Häufig werden diese Daten dezentral verarbeitet, das heißt ‚quellennah‘ oder nur innerhalb der betreffenden Abteilung gespeichert und verwendet. In diesen dienen die Daten der punktuellen Bewältigung spezifischer Herausforderungen – es entstehen Datensilos. Es ist allerdings nicht ohne weiteres möglich, diese Systeme unternehmensweit auszurollen und auf andere Bereiche und Produkte zu skalieren. Jede Anpassung erfordert Entwicklungsaufwand.

Auch die Anbindung weiterer, abteilungsfremder Datenquellen an ein erfolgreich implementiertes System erweist sich in der Praxis oft als schwierig, da sowohl das Datenformat als auch die Schnittstelle maschinen-, produkt- oder anwendungsspezifisch sind. Spätestens hier zeigt sich der Nutzen einer kohärente Datenstrategie. Sie gibt vor, wie Daten gesammelt, aufbereitet, gespeichert und genutzt werden. Grundvoraussetzung dafür ist die passende technische Basis.

Die Rolle der Semantik

Ein wesentlicher Aspekt ist die Semantik, also das einheitliche Verständnis über Bedeutung (und Kontext) von Daten. Durch das Erfassen und Einbeziehen der Semantik der Daten ist es möglich, diese universell verwendbar zu machen, miteinander zu vergleichen oder losgelöst von der Datenquelle zu nutzen. Denn eine Datenreihe ist nur dann wertvoll, wenn alle Nutzer nachvollziehen können, worauf sich die Angaben beziehen bzw. was sie konkret bedeuten. SAP-Verantwortliche wissen, dass sie handeln müssen – aber nicht, wie sie fundiert entscheiden. ‣ weiterlesen

SAP-Transformation mit Augenmaß: Sicherheit für die richtige Entscheidung

Ein einzelnes Produkt kann jedoch sehr viele Daten generieren. Hier sorgen sogenannte Aspekte für eine bessere Übersicht: Sie bündeln konkrete, auf Nutzergruppen ausgelegte Informationen, wie beispielsweise (dynamisch erfasste) Zustandsdaten, aber auch Stammdaten und Informationen aus Entwicklung und Produktion. Softwareanwendungen können dann gezielt auf diese Aspekte zugreifen und Mitarbeitenden genau die Informationen zur Verfügung stellen, die sie brauchen.

Die digitalen Repräsentanten

Semantik in der Datenintegration ist der Kern des Digital Twin-Ansatzes, einem digitalen Datenzwilling realer Produkte. Ein Zwilling selbst besteht wiederum aus einer Reihe von Aspekten, also einer Gruppierung von verwandten technischen Rohdaten mit Kontextinformationen. Der Zugriff erfolgt über einen zentralen Punkt, was auch die Rechte- und Zugriffsverwaltung vereinfacht.

Um einen datengetriebenen Lebenszyklus zu unterstützen, werden digitale Zwillinge idealerweise erstellt, sobald die ersten Informationen zu ihrem physischen Gegenstück bereitstehen: bereits in der Planungs- und Entwicklungsphase des Produkts oder beim Anstoßen des Produktionsprozesses durch eine Bestellung. Sie begleiten das Produkt über die Herstellung und Nutzung bis zur Außerbetriebnahme und dienen in dieser kompletten Zeitspanne – die je nach Produkt Jahrzehnte betragen kann – als zentraler Punkt für die Organisation und Strukturierung der Daten.

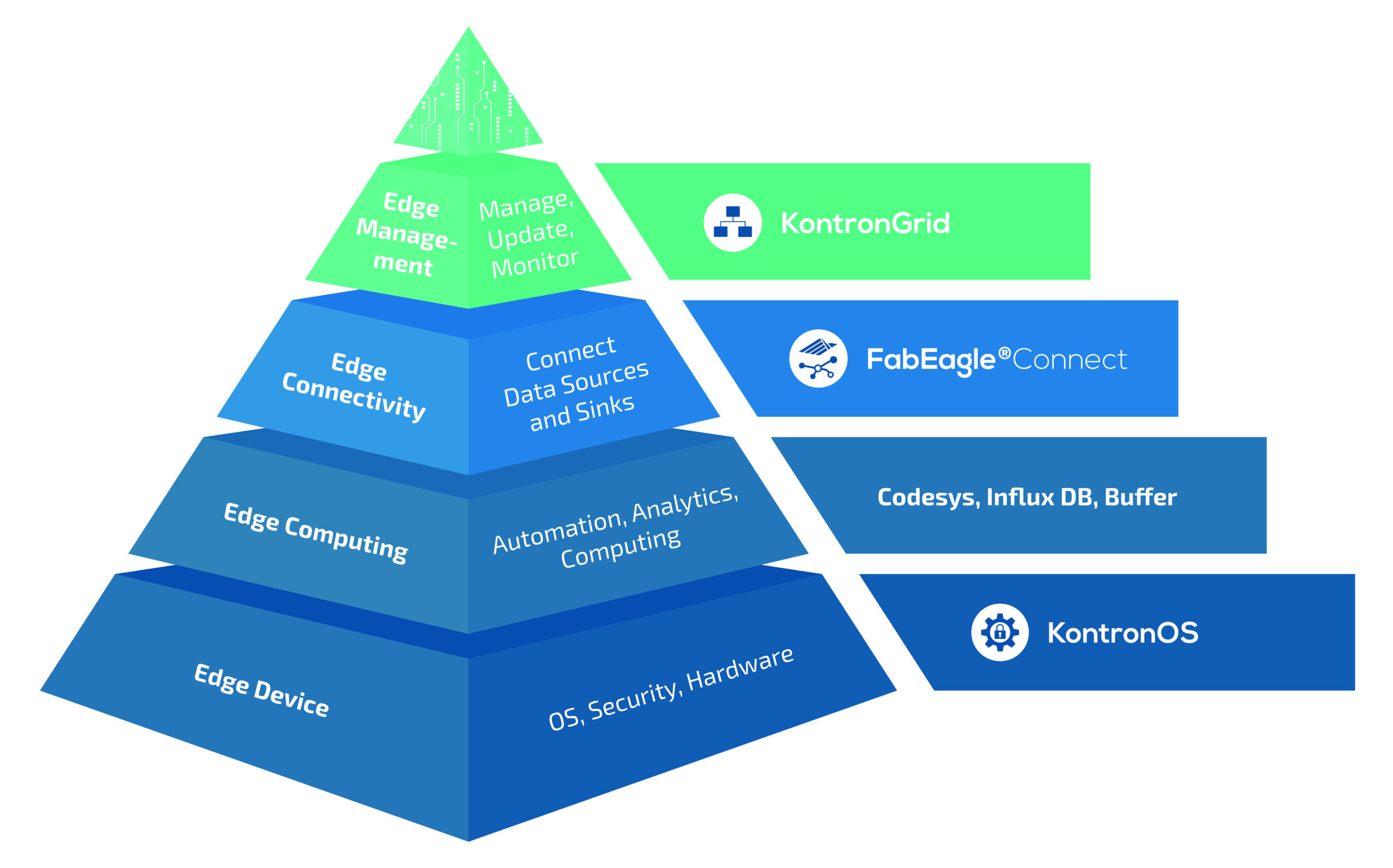

Blueprint per Software-Framework

Bei der Umsetzung der Datenstrategie hilft ein integratives Software-Framework. Ein Beispiel ist etwa der von Bosch Connected Industry entwickelte Semantic Stack, der Tools zur der Datenbeschreibung und -homogenisierung beinhaltet. Er ermöglicht es, mit einer Blueprint-Architektur ab dem ersten Anwendungsfall eine kohärente, skalierbare Datenstrategie zu implementieren – vom semantischen Grundgerüst bis hin zur Anwendungsebene.

Weitere Anwendungsfälle

Die Einführung einer ganzheitlichen Datenstrategie kann iterativ erfolgen. Ausgehend von einzelnen Projekten lässt sich der neue Ansatz schrittweise einführen – beispielsweise für eine bestimmte Produktgruppe oder Lebenszyklusphase. So erweitert sich das Netzwerk an untereinander nutz- und lesbaren Daten immer weiter, was das Aufsetzen weiterer Systeme vereinfacht.

Als Beispiel kann hier etwa ein Update-Manager dienen, der auf die digitalen Zwillinge von Tausenden im Feld befindlichen Produkten zugreifen kann. Weitere Produktgruppen lassen sich angliedern oder das System kann auf einen weiteren Datenpool übertragen werden. Die Anzahl an angegliederten Produkten wächst und weitere Systeme können darauf aufgesetzt werden – etwa ein Tool, das die Fehlerquote von Updates analysiert. Kommen neue gesetzliche Anforderung, lässt sich eine Oberfläche zum Aufrufen dieser Informationen implementieren.

Das Beispiel zeigt: Ist die Architektur einmal implementiert, lassen sich weitere Datenquellen anbinden und Tools hinzufügen. Dabei steht der jeweils bereits angebundene Datenpool neuen Anwendungen zur Verfügung, was den Umfang der möglichen Funktionalitäten erweitert und immer weitere Bereiche aus dem Lebenszyklus integrierbar macht. Dieses Szenario ist um weitere Anwendungsfälle erweiterbar und bildet die technische Grundlage für eine intelligente, kohärente Datenstrategie.